CrowdStrike شارلوت الذكاء الاصطناعي: نظرة عامة على الحل، المزايا والعيوب

- 5 minutes to read

فهرس المحتويات

ما هو الذكاء الاصطناعي CrowdStrike شارلوت؟

تشاتلوت AI من كراودسترايك هو مساعد ذكاء اصطناعي توليدي لفرق الأمن السيبراني باستخدام منصة كراودسترايك فالكون. من خلال الاستفادة من نماذج الذكاء الاصطناعي وبيانات المراقبة الخاصة بمنصة فالكون، تهدف تشاتلوت AI إلى تبسيط العمليات الأمنية وتقليل أوقات التحقيق.

تتيح أداة "Charlotte AI" للمستخدمين توجيه سير العمل، وتصنيف الاكتشافات، والحصول على إجابات لاستفسارات معقدة بلغة بسيطة. تدمج الأداة معلومات التهديدات مع بيانات الاستخدام المجهولة وسياق إضافي.

الميزات الرئيسية لـ CrowdStrike Charlotte AI

تقدم CrowdStrike Charlotte AI الميزات الرئيسية التالية:

- سير العمل المدعوم بالذكاء الاصطناعي التوليدي: يستخدم بنية متعددة النماذج من الذكاء الاصطناعي المدمجة مع معلومات التهديدات لتوفير رؤى لفرق الأمن لتصنيف الحوادث، وتحليل نشاط الخصوم، وأتمتة الاستجابات.

- تفاعل المستخدم المبسط: من خلال معالجة اللغة الطبيعية، يسمح للمحللين بإنشاء نصوص، وشرح سطور الأوامر، واستخراج البيانات دون الحاجة لإتقان لغات البرمجة المعقدة أو البحث في الوثائق.

- التحقيق والاستجابة المعجلة: يقلل من أوقات التحقيق من خلال السماح للمستخدمين بالتعمق في التهديدات الناشئة ومؤشرات وجود الخصوم. يمكّن الاستعلام في الوقت الحقيقي عن بيئة تكنولوجيا المعلومات عبر نقاط النهاية والخوادم وأحمال العمل السحابية. يمكن للمحللين أيضًا إنشاء ومشاركة دفاتر الملاحظات لتبسيط سير العمل في الفريق.

- زيادة إنتاجية المحللين: يعمل على أتمتة المهام الروتينية مثل إنشاء الحوادث، والتحليل، والتقارير لمساعدة فرق الأمن على توفير الوقت.

- اعتماد الذكاء الاصطناعي بشكل آمن وشفاف: يعمل مع تدابير أمان، بما في ذلك رؤى قابلة للتتبع والتدقيق. تقلل ضوابط الوصول المعتمدة على الأدوار والحمايات المدمجة من المخاطر مثل هلوسات الذكاء الاصطناعي مع ضمان الاستخدام الآمن عبر الفرق.

- ديمقراطية الخبرة: تغلق الفجوة في المهارات وتضغط دورات الانضمام، مما يسمح للفرق بالعمل بمستويات مختلفة من الخبرة.

فهم كيفية عمل الذكاء الاصطناعي لشركة CrowdStrike في شارلوت

يعمل نظام الذكاء الاصطناعي "شارلوت" من كراودسترايك من خلال بنية تركز على السرعة والأمان عبر سير العمل الأمني. يستفيد هذا النهج من نظام متعدد الذكاء الاصطناعي يدمج وكلاء ذكاء اصطناعي متخصصين، وبيانات كراودسترايك، وتقنيات الذكاء الاصطناعي التوليدي. إليك تحليل لكيفية عمل "شارلوت".

بنية متعددة للذكاء الاصطناعي

تستخدم "شارلوت إيه آي" بنية متعددة للذكاء الاصطناعي، حيث يتم تقسيم سير العمل إلى مهام فرعية منفصلة، ويتولى وكلاء ذكاء اصطناعي متخصصون التعامل مع كل مهمة. تم تصميم هؤلاء الوكلاء لأدوار معينة، مثل استرجاع البيانات، أو توليد النصوص، أو تحليل معلومات التهديد.

تسمح الهندسة المعمارية للنظام باختيار أفضل نموذج أساسي لكل مهمة فرعية، مما يضمن الدقة دون المساس بالأمان أو تحميل المحللين بتعقيد إضافي.

من خلال الاستفادة من نماذج ذكاء اصطناعي متنوعة وعزل استخدامها، تقلل تشارلوت AI من التنازلات المرتبطة بالاعتماد على نموذج واحد.

وكلاء الذكاء الاصطناعي الموجهين نحو المهام

تستخدم شارلوت AI أكثر من عشرة وكلاء ذكاء اصطناعي تم ضبطهم لأداء مهام مختلفة. يعمل هؤلاء الوكلاء معًا للتعامل مع طلبات المستخدم، واسترجاع البيانات ذات الصلة، والتحقق من المخرجات، وتنسيق الإجابات الكاملة. تشمل العملية الخطوات التالية:

- فهم السؤال: يقوم وكلاء الذكاء الاصطناعي أولاً بتفسير مدخلات المستخدم، واستخراج الكيانات الرئيسية مثل الفاعلين المهددين، والثغرات، أو مؤشرات الاختراق.

- توجيه المهام الفرعية: يقوم وكيل التوجيه بتحديد أي من وكلاء الذكاء الاصطناعي المتخصصين يجب أن يتعامل مع كل جانب من جوانب الطلب.

- استرجاع البيانات أو تنفيذ المهام: بالنسبة للطلبات التي تتطلب استدعاءات واجهة برمجة التطبيقات (مثل، البحث عن المؤشرات)، تقوم الوكلاء المخصصون باسترجاع البيانات اللازمة. بالنسبة للمهام الأخرى، مثل إنشاء نص بلغة الاستعلام الخاصة بـ CrowdStrike (CQL)، تتولى وكلاء آخرون تنفيذ ذلك.

- التحقق: يقوم وكيل التحقق بمراجعة المخرجات لضمان اكتمالها ودقتها، مع الإشارة إلى أي تناقضات أو معلومات مفقودة.

- توليد الاستجابة: يقوم وكيل نهائي بترتيب الاستجابة في تنسيق يمكن قراءته من قبل الإنسان.

وسائل الحماية ضد الهلوسات

لتقليل مخاطر الهلوسات الناتجة عن الذكاء الاصطناعي التوليدي (المخرجات غير الدقيقة أو غير المدعومة)، تتضمن "Charlotte AI" عدة تدابير أمان. تشمل هذه التدابير وكلاء التحقق الذين يتحققون من المخرجات مقابل بيانات منصة "Falcon" ومراقبة الأداء الخاصة بالمهام. من خلال عزل المهام عبر عدة وكلاء ونماذج ذكاء اصطناعي، يمكن لـ"Charlotte AI" تقليل تأثير أي فشل في نموذج واحد، مما يضمن تجربة مستخدم متسقة وآمنة.

تسريع سير العمل من خلال الذكاء الاصطناعي التوليدي

يعمل الذكاء الاصطناعي 'شارلوت' على تسريع التحقيق والاستجابة من خلال تمكين المستخدمين من التفاعل مع منصة 'فالكون' عبر اللغة الطبيعية. يمكن للمحللين استعلام بيئة تكنولوجيا المعلومات بالكامل، وإنشاء قواعد الكشف، أو تحليل معلومات التهديدات في الوقت الحقيقي. على سبيل المثال، يمكن لشارلوت AI المساعدة في إنشاء وتشغيل استعلامات CQL، والتحقيق في ثغرات اليوم صفر، أو تحليل مؤشرات الاختراق.

هذا التصميم يتيح للفرق من جميع مستويات المهارة العمل بكفاءة. يمكن للمحللين المبتدئين أداء مهام متقدمة مثل استعلام مجموعات البيانات الكبيرة أو إنشاء نصوص التخفيف، بينما يستفيد المستخدمون ذوو الخبرة من توفير كبير في الوقت.

المحتوى ذي الصلة: اقرأ دليلنا حولتحليلات الأمان

قيود الذكاء الاصطناعي لشركة كراودسترايك في شارلوت

بينما تقدم شارلوت AI مزايا كبيرة في العمليات الأمنية، إلا أن لديها بعض القيود التي ينبغي على الفرق أخذها بعين الاعتبار:

- الاعتماد على منصة فالكون: تتكامل Charlotte AI بشكل عميق مع منصة CrowdStrike Falcon. بينما يضمن ذلك وظائف سلسة لمستخدمي فالكون، قد تجد المنظمات التي تستخدم أدوات أمان أخرى محدودية في التوافق.

- قيود الدقة وهلاوس الذكاء الاصطناعي: مثل جميع نماذج الذكاء الاصطناعي التوليدية، يمكن أن ينتج تشارلوت AI أحيانًا استجابات غير دقيقة أو مضللة. لقد نفذت CrowdStrike تدابير أمان، مثل وكلاء التحقق وضوابط الوصول المعتمدة على الأدوار، ولكن يجب على المستخدمين التحقق من المخرجات قبل اتخاذ أي إجراء.

- تخصيص محدود لحالات الاستخدام غير القياسية: تم تحسين شارلوت AI لتدفقات العمل الأمنية الشائعة، ولكن قدرته على التعامل مع حالات الاستخدام المخصصة أو غير التقليدية محدودة. قد تحتاج الفرق الأمنية التي لديها احتياجات تشغيلية فريدة إلى دعم الرؤى المدفوعة بالذكاء الاصطناعي بتحليل يدوي.

- متطلبات الموارد لتحقيق الأمثل الكامل: قد تحتاج المنظمات التي تسعى لتعظيم قدرات الذكاء الاصطناعي في شارلوت إلى استثمار الوقت في تدريب المحللين لاستخدام النظام بفعالية. بينما تقلل الأداة من وقت التدريب، قد تحتاج الفرق غير المألوفة مع وحدات فالكون إلى بعض الوقت للتكيف.

إكزابييم: البديل النهائي لكراودسترايك تشارلوت AI

يُعيد الذكاء الاصطناعي الوكالي تعريف عمليات الأمن من خلال الانتقال من الكشف السلبي إلى الدفاع الاستباقي، مما يمكّن الأنظمة المدفوعة بالذكاء الاصطناعي من التحقيق في التهديدات، وارتباط البيانات، وتنفيذ إجراءات الاستجابة بشكل مستقل. مع استمرار تطور التهديدات السيبرانية، تحتاج فرق الأمن إلى حلول تتجاوز المساعدين الثابتين في مجال الذكاء الاصطناعي وتقدم ذكاءً تكيفياً في الوقت الحقيقي.

تم تصميم Exabeam Nova خصيصًا لتلبية هذه المتطلبات، حيث يعمل كعامل مضاعف للقوة داخل مركز العمليات الأمنية (SOC). من خلال أتمتة التحقيقات، وتقليل التعب الناتج عن التنبيهات، وتسريع أوقات الاستجابة، يمكّن المحللين من العمل بكفاءة وفعالية أكبر. مع التكامل السلس في New-Scale Platform، يلغي Exabeam Nova الحاجة إلى أدوات منفصلة، مما يضمن أن تكون الرؤى المدفوعة بالذكاء الاصطناعي مدمجة مباشرة في سير العمل الأمني القائم.

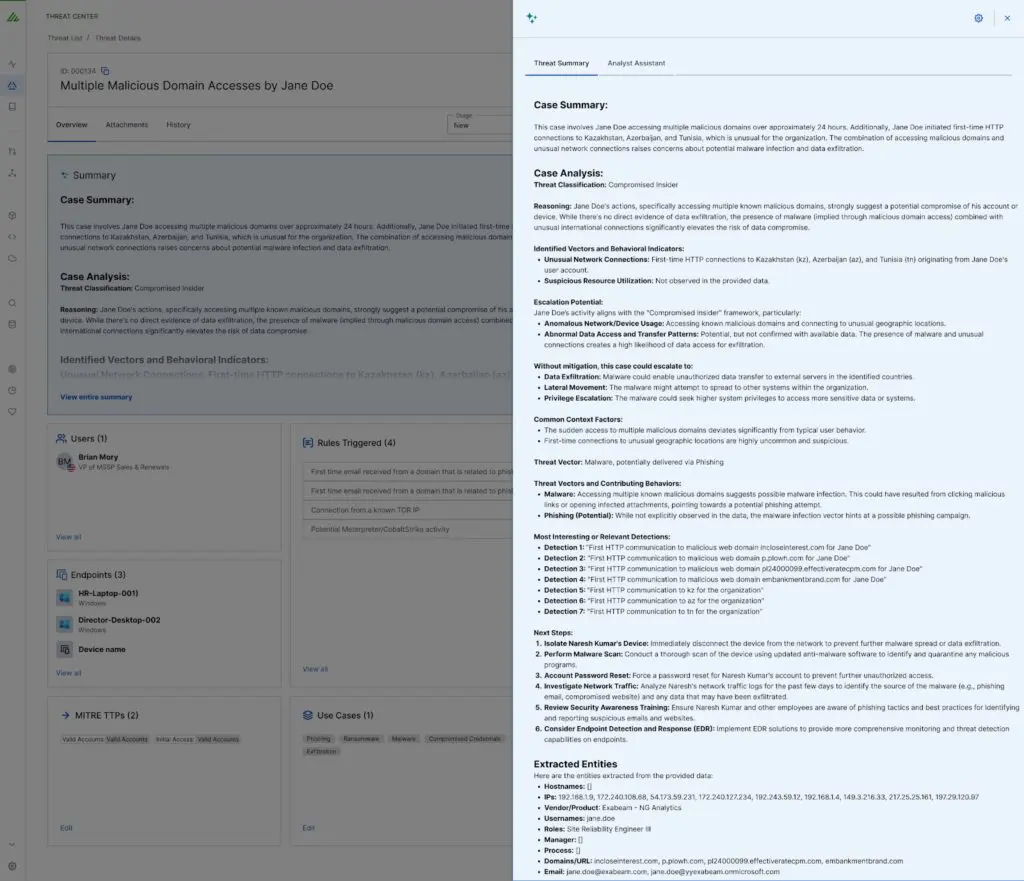

على عكس المساعدين التقليديين المدعومين بالذكاء الاصطناعي، يقوم Exabeam Nova بتعديل أسلوبه في التحقيق ديناميكيًا بناءً على شدة وسياق كل تهديد. يقدم رؤى دقيقة وقابلة للتنفيذ مصممة لكل من المحللين في الخطوط الأمامية وقادة الأمن، مما يضمن أن كل صاحب مصلحة لديه المعلومات اللازمة لاتخاذ قرارات مستنيرة. يقوم Exabeam Nova بتطوير ملاحظات ملخصة غنية للحالات داخل مركز تهديدات، تجمع بين مؤشرات التهديد الرئيسية، والكشف المرتبط، والإجراءات الموصى بها، مما يقلل من الوقت الذي يقضيه المحللون في تجميع البيانات المجزأة.

مبني على إطار تصنيف التهديدات الخاص بشركة Exabeam ويستفيد من بيانات تدريب أكثر بعشر مرات من سابقيه، فإنه يوفر معرفة أعمق في التحقيقات وأولوية تهديدات أكثر دقة.

تظل الأمان والامتثال في صميم Exabeam Nova. على عكس الحلول الأخرى المعتمدة على الذكاء الاصطناعي التي تعتمد على التدريب السحابي الخارجي، يضمن Exabeam Nova أن تظل بيانات العملاء خاصة وآمنة. لا تُستخدم تفاصيل التحقيق في تدريب النماذج، ويتم معالجة جميع البيانات داخل بيئة Exabeam الموثوقة، مما يحافظ على الامتثال للوائح الصناعة ويحمي المعلومات الحساسة.

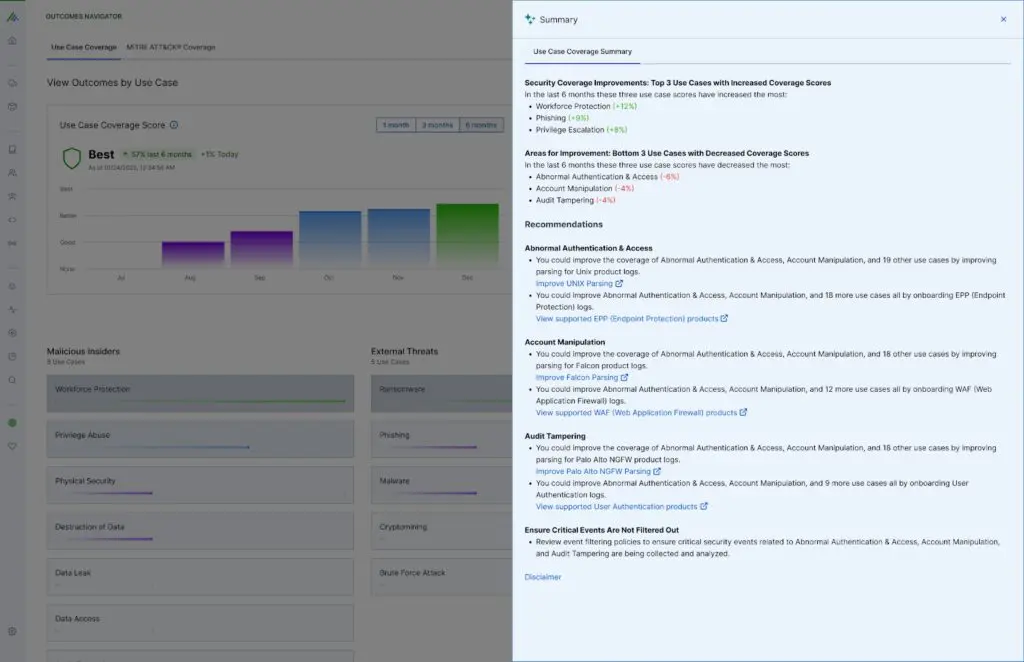

بجانب التحقيقات، يعزز Exabeam Nova تقييمات الوضع الأمني من خلال Outcomes Navigator، حيث يساعد الفرق في تقييم تغطية حالات الاستخدام، وتحديد الفجوات، وتقديم توصيات مستهدفة لتعزيز الدفاعات. من خلال تحليل مصادر السجلات، ونماذج السلوك، واستخدام القواعد، يمكّن المنظمات من تحسين استراتيجيتها الأمنية بشكل مستمر.

مع تزايد تعقيد التهديدات السيبرانية المدفوعة بالذكاء الاصطناعي، لم تعد المنظمات قادرة على الاعتماد على نماذج الأمان القديمة. تقدم Exabeam Nova استراتيجية أمان استباقية مدفوعة بالذكاء الاصطناعي تمكن الفرق من اكتشاف التهديدات بشكل أسرع، والاستجابة بثقة أكبر، وتعزيز وضعهم الأمني بشكل مستمر. مستقبل عمليات الأمان هنا - وهو مدعوم من Exabeam Nova. لمزيد من المعلومات قم بزيارة Exabeam.com

تعلم المزيد عن إكزابييم

تعرف على منصة Exabeam ووسع معرفتك في أمن المعلومات من خلال مجموعتنا من الأوراق البيضاء، البودكاست، الندوات، والمزيد.

-

مدونة

مدونة

What’s New in New-Scale April 2026: Securing the Agentic Enterprise With Behavioral Analytics

- عرض المزيد